Die flexible MDM-Lösung ableX für das zentrale Management von Artikelstammdaten und die intelligente Datenkommunikation bietet mit dem Modul DQM (Data Quality Management) die Möglichkeit, individuelle Prüfroutinen mit Regeln, Filtern und Formeln einzurichten. Dadurch wird die Qualität von Millionen von Daten den eigenen Anforderungen und der Data Governance des Unternehmens angepasst. Dies ermöglicht die Überarbeitung bestehender Daten und die Aufnahme neuer Artikel sowie das Filtern von Dubletten und Erkennen von fehlenden oder fehlerhaften Preisen. Den gesamten Qualifizierungsprozess vom Import der Daten bis zum Export an die angeschlossenen Systeme überwacht ableX.

"Stammdaten stellen einen hohen Wert dar, der umso höher ist, je besser sie gepflegt sind", erklärt Michael te Laak, Geschäftsführer von ARM Advanced Resource Management. "ableX verwaltet und prüft die Stammdaten zentral, um ihre Qualität aufzuwerten und die Verarbeitung zu beschleunigen. Dadurch setzt ableX ganz neue Maßstäbe für die Datenqualität." Indem die MDM-Lösung den Aufwand und die Kosten für die Datenpflege senkt, steigert sie die Wettbewerbsfähigkeit der Unternehmen.

ableX-DQM - Stammdaten in bester Qualität

ableX-DQM bietet umfangreiche Formeln und Regeln, mit denen jedes einzelne Feld schon beim Import qualifiziert wird: Einzelne Wörter, Werte und Textabschnitte können herausgefiltert und in andere Felder überführt werden. Inhalte werden zusammengefügt oder in verschiedenen Feldern getrennt. Anwender können aber auch bestehende Daten tabellarisch mit Formeln und Regeln überarbeiten, um sich ihr gewünschtes Umfeld zu schaffen und neue Artikel schnell und komfortabel zu erstellen.

Prüfroutinen unterstützen die Anwender bei der Pflege und beim Import von Preisen. Fehlende Preise werden erkannt und überzogene Teuerungen gelistet. So bleiben selbst bei extrem großen Datenmengen falsche Preise nicht unentdeckt. Dubletten erkennt ableX-DQM anhand der Artikeltexte, auch wenn die Schreibweise der Artikel unterschiedlich ist und im Text falsch geschriebene Wörter vorkommen. Das von Dubletten bereinigte System ist eine optimale Grundlage für Datenkommunikation und ein aussagefähiges Berichtswesen.

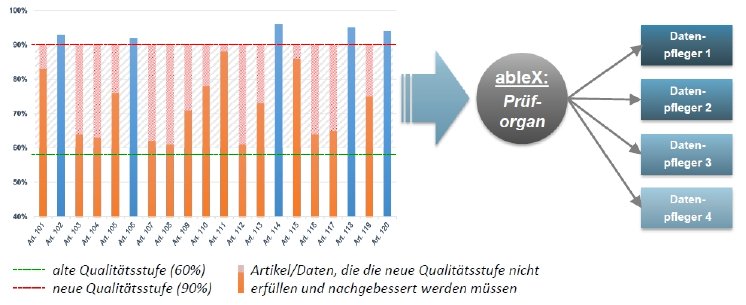

Die Qualität der Daten kann das Unternehmen selbst individuell definieren. Soll die Datenqualität zum Beispiel um 20 Prozent angehoben werden, filtert ableX alle Daten heraus, die den neuen, höheren Qualitätsanforderungen nicht genügen und nachgebessert werden müssen. Das System generiert einen Workflow und sendet die fehlerhaften beziehungsweise ungenügenden Daten automatisch mit einem Prüfprotokoll und Aufgaben an den zuständigen Datenpfleger oder Datenlieferanten zur Nachbesserung.

Vier Stufen der Datenqualifizierung

Alle Daten durchlaufen vier Stufen der Daten-Qualifizierung: die Basis-Qualifikation schafft durch den Aufbau dynamischer Felder mit individuellen Qualitätsanforderungen und die Hinterlegung von Regeln und Formeln die Grundlage für eine hohe Datenqualität. Es folgt die Import-Qualifikation, bei der die verschiedenen Datenformate (CSV, BMEcat, Datanorm usw.) in ein einheitliches Format umgewandelt, automatisch referenziert und von ableX auf Feldebene bewertet werden.

Die dritte Stufe ist die Datenveredelung, bei der die Daten - durch den Anwender geführt - nachbearbeitet werden. Damit nicht jeder Datensatz einzeln bearbeitet werden muss, bietet ableX eine tabellarische Bearbeitung von Massendaten. Diese werden während des gesamten Prozesses bewertet, da eine Qualitätsprüfung mitläuft und den Anwender auf Fehler hinweist.

Zum Abschluss erfolgt die Exportqualifikation, um die Qualitätsanforderung und Qualitätsstatistik auf das Zielsystem auszurichten. So bestehen etwa für einen Webshop andere Qualitätsanforderungen als für ein ERP-System, wodurch eine zentrale Datenpflege gerade für Handelsunternehmen unabdingbar ist. ableX wandelt die Daten vollautomatisch in das entsprechende Protokoll und Format des Zielsystems um.